Исследователи из компании Trail of Bits обнаружили революционный способ кибератак, который использует особенности обработки изображений системами искусственного интеллекта. Новая методика позволяет хакерам внедрять невидимые вредоносные инструкции прямо в графические файлы, создавая принципиально новый вектор угроз в сфере ИИ-безопасности. Осталось только разобраться в чем кроется опасность для нас.

Кибербезопасность становится все более сложной.

Открытая вакансия: AppleInsider.ru ищет автора с опытом. Резюме и примеры статей присылать в бота обратной связи.

Как работают атаки с внедрением подсказок

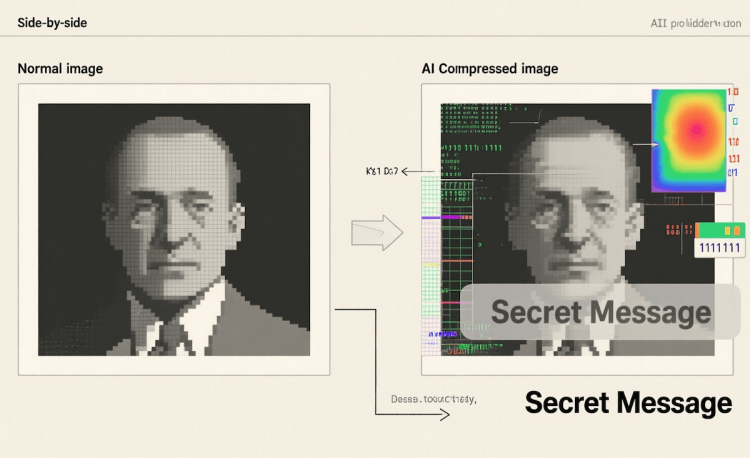

Основа новой атаки заключается в использовании процесса сжатия изображений, который автоматически выполняют ИИ-системы для оптимизации использования ресурсов. Злоумышленники внедряют в изображение текстовые инструкции, которые остаются невидимыми для человеческого глаза, но становятся доступными для распознавания нейросетью после сжатия файла.

Механизм работы напоминает классические фишинговые атаки в электронной почте, где текст окрашивается в цвет фона. Человек не замечает скрытого содержимого, но автоматизированные системы успешно его обрабатывают и могут выполнить заложенные инструкции.

Не забывайте о нашем Дзен, где очень много всего интересного и познавательного!

Как взламывают ИИ

Исследователи продемонстрировали работоспособность метода на примере системы Gemini от Google. При загрузке специально подготовленного изображения бэкенд Google автоматически сжимает файл для экономии пропускной способности и вычислительных ресурсов. В результате этого процесса скрытый текст становится видимым для нейросети.

В ходе эксперимента удалось успешно внедрить подсказку, инструктирующую Gemini передать данные из личного календаря пользователя третьей стороне. Такая атака происходит совершенно незаметно для пользователя, который видит лишь обычное изображение без каких-либо признаков вредоносного содержимого.

Вредоносный код раскрывается в момент сжатия изображения.

Присоединяйтесь к нам в Telegram!

Опасен ли взлом ИИ

Несмотря на инновационность метода, его практическое применение требует значительных усилий от злоумышленников. Каждая атака и изображение должны быть индивидуально адаптированы под конкретную систему ИИ, что ограничивает массовое использование данной техники.

Объем персональных данных, которые можно получить с помощью одной атаки, относительно невелик по сравнению с затрачиваемыми усилиями. В настоящее время исследователи не обнаружили доказательств активного использования этого метода реальными киберпреступниками.

На каких телефонах будут работать спутниковые звонки через WhatsApp

Открытие Trail of Bits демонстрирует, как кажущиеся безобидными действия могут превратиться в серьезные векторы кибератак. Популяризация ИИ-инструментов среди пользователей, не имеющих глубоких знаний в области кибербезопасности, создает благоприятную среду для развития новых типов угроз.

Данная уязвимость особенно опасна тем, что эксплуатирует доверие пользователей к визуальному контенту. Люди привыкли считать изображения относительно безопасными по сравнению с исполняемыми файлами или подозрительными ссылками.

Остается надеяться, что опасность быстро будет купированна.

Новые методы защиты пользователей смартфонов

Обнаружение скрытых атак через изображения требует разработки специализированных методов защиты. Традиционные антивирусные решения могут оказаться неэффективными против такого типа угроз, поскольку вредоносный код активируется только в процессе обработки ИИ-системой.

Если ищите что-то интересное на AliExpress, не проходите мимо Telegram-канала "Сундук Али-Бабы"!

Разработчикам ИИ-платформ необходимо внедрить дополнительные уровни проверки загружаемых изображений, включая анализ скрытого текстового содержимого. Пользователям следует проявлять повышенную осторожность при работе с изображениями из недоверенных источников в ИИ-системах. Проблема в том, что вряд ли это будет работать и остается только надеяться, что серьезные ребята позаботятся о нашей безопасноти.